| HIFI-FORUM » Fernseher & Beamer » Scaler, Linedoubler & Videoprocessing » Auswirkungen der Skalierung von Filmen mit Full-HD... | |

|

|

||||

Auswirkungen der Skalierung von Filmen mit Full-HD/UHD-Auflösung auf 2K/4K-TV-Geräten+A -A |

|||||||||||||||||||

| Autor |

| ||||||||||||||||||

|

celle

Inventar |

#51

erstellt: 06. Jun 2014, 06:38

|

||||||||||||||||||

|

Zu DVD-Zeiten hatte Sony aber nicht wirklich die besseren Produkte. Die Gründe warum Sony es heutzutage so schlecht geht, sind auf Fehler in dieser Zeit zurückzuführen. Lautschreiendes Marketing ist aber sicherlich heutzutage ein wohl noch entscheidender Faktor für den Erfolg eines Produktes. Da gebe ich dir durchaus Recht. Der Markt hat sich aber geändert und die Auswahl ist kleiner geworden. All zu viele Hersteller sind halt nicht mehr übrig geblieben aus denen der "traditionelle" Enthusiast wählen kann. Dieses "Umdenken im Kopf" - wie es so ähnlich bei einem Autohersteller heißt - muss da bei einigen noch stattfinden um neue Alternativen anzuerkennen. |

|||||||||||||||||||

|

hagge

Inventar |

#52

erstellt: 06. Jun 2014, 07:44

|

||||||||||||||||||

Dir ist aber schon klar, dass die HD-Sender mit sagen wir mal 10 bis maximal 15 MBit/s fahren und die BD etwa 30-50 MBit/s an Datenrate hat? Und dass diese Datenrate natürlich Auswirkungen auf die Bilddetails hat? Aber darum geht es eigentlich gar nicht. Du wolltest mit Deiner Aussage implizieren, dass 1080i rein technisch gesehen kein 1080p ist und *immer* schlechter aussieht, weil die Sender ja "nicht mal echtes Full-HD senden". Und diese Aussage ist schlichtweg falsch. Bei gleicher Datenrate und dem entsprechenden Fernseher mit gutem Deinterlacer ist das absolut gleichwertig und die Sendung kann genauso als 1080p angeschaut werden wie die BD. Mehr wollte ich nicht sagen und mehr braucht man dazu auch nicht sagen, denn damit ist Deine Aussage vom schlechten TV-Format 1080i einfach schon widerlegt. Zudem frage ich Dich nun schon zum wiederholten mal, was denn eine schlechte 2K-Ausstrahlung von Fernsehsendern damit zu tun hat, wenn es hier bei der Diskussion um höchste Bildqualität in 4K geht? Warum Du also immer auf dem 1080i rumreitest? Ups, ich sehe sogar, dass Du gerade von DVB-T sprichst. Dass DVB-T so ziemlich das Miserabelste ist, was an Sendersignalen rumläuft, ist klar. Dass DVB-T noch nicht mal HDTV sendet, sondern nur SD, ist auch klar. Dass ein solches Signal niemals mit einem HD-Signal von einer BluRay vergleichbar ist, ist klar. Hat auch niemand hier jemals behauptet. Was soll also Deine Aussage? Sorry, aber auf dieses Niveau der Diskussion lasse ich mich nun nicht mehr herab. Gruß, Hagge |

|||||||||||||||||||

|

|

|||||||||||||||||||

|

beehaa

Gesperrt |

#53

erstellt: 06. Jun 2014, 08:16

|

||||||||||||||||||

SD skalieren konnten damals die HD-Fernseher aber auch selbst oder? Wie kam es denn zu den Hypes? Auf allem anderen Player sah es schlechter aus? Und wie taten sich da die HD-Fernseher selbst? Wie lauten diese Namen heute, wenns um 4k geht? Oder ist das wundersamerweise bei 4k ab Werk bei jedem Hersteller alles immer Faroudja-like? p.s.:

Geht doch immernoch garnicht   |

|||||||||||||||||||

|

celle

Inventar |

#54

erstellt: 06. Jun 2014, 08:48

|

||||||||||||||||||

Scaling und Deinterlacing war bei den integrierten TV-Lösungen nicht auf dem Niveau externer Lösungen. Die DVD-Player mit hochwertigen Scalern hatten tatsächlich ein subjektiv "schöneres" Bild, dazu das Kantenflimmern deutlich gemindert. Der erste Player mit 1080i-Scaler und digitaler Schnittstelle (DVI) kam gar von Samsung mit dem HD935. Davor war Progressive Scan über YUV das höchste der Gefühle. Es ging hier nur um eine Vollbildwandlung von 576i auf 576p. Nach dem Samsung zogen dann Pioneer und Denon mit Faroudja-Scaler nach und es gipfelte dann im HQV Reon, Realta und Marvell QDEO mit 1080p-Scaling. Sony war da übrigens nie wirklich vorne dabei und deren selbst hochwertigsten Player zeichneten sich dadurch aus, dass sie falch gesetzte Flags oft nicht erkannten, Video- und Filmmodus durcheinander brachten und zu Kantenflimmern neigten. Für Videophile waren die Sony-Player also nicht erste Wahl. Dafür waren sie eher audiophil abgestimmt.  http://www.marvell.com/digital-entertainment/qdeo/ http://www.marvell.com/digital-entertainment/qdeo/ http://media.digikey.com/pdf/Data%20Sheets/IDT/REON_VX_Flyer.pdf http://media.digikey.com/pdf/Data%20Sheets/IDT/REON_VX_Flyer.pdfDas die 4K-Anhänger aktuell auf interne Lösungen setzen, liegt einfach daran, dass es aktuell keine sonderlich hochwertigeren 4K-Scaler in entsprechenden Playern zu den TVs mehr gibt. Dazu eben noch keine 4K-BD, wo ein Hersteller wie Denon einen lohnenswerten Premium-Universal-Player auf den Markt werfen könnte. Durch die zunehmenden Smart-Funktionen werden die TV´s ja nun auch mit diversen Prozessoren vollgestopft. Qualcomm hat bspw. HQV aufgekauft.  http://www.idt.com/a...rocessing-assets-idt http://www.idt.com/a...rocessing-assets-idt [Beitrag von celle am 06. Jun 2014, 08:49 bearbeitet] |

|||||||||||||||||||

|

hagge

Inventar |

#55

erstellt: 06. Jun 2014, 10:33

|

||||||||||||||||||

Diese Parameter zu nennen ist natürlich bei irgendwelchem Demo-Material oder einem Spielfilm nicht so einfach machbar. Fakt ist aber, und das kannst Du mir bitte glauben, das 4K-Material sah wirklich superb aus. Das war wirklich Material, das viel viel mehr Details aufwies als ein normales 2K-Marterial.

Natürlich ist das ein Punkt, den ich bei solchen Veranstaltungen auch immer im Hinterkopf habe. Wenn man aber selbst die DVD mitgebracht hat, die dann auf dem 4K-Gerät abgespielt wird, dann ist da mit Tricksen nicht mehr viel möglich. Wenn man auf dem einen 4K-TV das native 4K-Bild als Standbild sieht, bis auf 1cm nah mit der Nase hingehen kann und wirklich sieht, wie jedes Pixel unterschiedlich ist, dann daneben an den zweiten 4K-TV geht, der das hochskalierte 2K-Material als Standbild zeigt, auch mit der Nase auf 1cm an den Schirm rangeht und da nur ganz ganz minimale Unterschiede sieht, dann weiß ich nicht, wo man da getrickst haben soll. Beide Filme wurden auf Zuruf an beliebigen Stellen angehalten. 2K ist nicht 4K, niemand behauptet das. Man *kann* ja noch Unterschiede erkennen. Bei einer Aufnahme vor dem Eiffelturm in Paris war das Laub der Bäume nicht ganz so detailliert wie bei 4K, bei einer Szene aus Total Recall waren ein paar hängende Kabel bei 4K nochmal feiner. Aber das skalierte 2K-Bild zeigte dermaßen viele Details, das war verblüffend. Zum Beispiel schräge Linien zeigten kaum Treppen, und das war sehr erstaunlich. Und schaltete man die Reality Creation (RC) ab, war es ja auch deutlich schlechter und zum Beispiel die Treppen wieder da. Das heißt die reine Skalierung schafft dieses Mehr an Bildinfo nicht, erst dieser Nachbrenner RC. Und das ist schon beeindruckend. Ich tu mir da immer schwer, jetzt eine einzelne Firma wirklich so hervorzuheben. Aber ein solches Verfahren wie die Reality Creation ist mir bisher nur von Sony bekannt, darum muss ich das zwangsweise immer zitieren und als Beispiel nehmen. Insofern kann es sogar sein, dass eine solche intelligente Skalierung, die über die reine Vergrößerung hinaus geht, tatsächlich nur bei Sony verfügbar ist. Da diese Reality Creation auch in der 2K-Version in meinem eigenen TV HX925 werkelt, kann ich auch durchaus eigene Erfahrung über einen nun schon recht langen Zeitraum seit 2011 zu diesem Thema mitbringen, und behaupte nicht nur Dinge, die ich einmal kurz auf einer Vorführung gesehen habe. Trotzdem möchte ich jetzt nicht behaupten, dass nur Sony gut skalieren kann. Auf der IFA gab es bei Panasonic am Stand tatsächlich die Anordnung, die ich mir immer wünsche, nämlich drei TVs nebeneinander: nativer 2K-TV, 4K-TV mit hochskaliertem 2K-Material und 4K-TV mit nativem 4K-Material. Und diesen Aufbau hätte Panasonic sicher nicht hingehängt, wenn es nicht tatsächlich einen sichtbaren Unterschied zwischen nativem 2K und hochskaliertem 2K-Material gegeben hätte. Nun kann man natürlich wieder böse unterstellen, dass da irgendwie getrickst wurde. Das kann ich natürlich nicht gänzlich ausschließen. Geht man aber davon aus, dass das nicht getürkt war, dann war auch bei Panasonic das skalierte Material definitiv besser als das native 2K-Material.

Seufz. Du hast aber meine Erklärungen zu Reality-Creation schon gelesen? Dass da Information aus einer Datenbank geholt wird, die dort mit höherer Auflösung abgespeichert ist? Wieso sollte dann nicht genau das möglich sein, also mehr geometrische Informationen zu haben als das Original? Ich bringe mal ein ganz anderes Beispiel. Es gibt Filme, die in Schwarzweiß gedreht wurden. Du wirst mir zustimmen, dass dabei jedwede Farbinformation verloren gegangen ist. Dennoch ist es mit entsprechendem Rechenaufwand möglich, diese Filme heutzutage in Farbfilme umzurechnen. So gibt es z.B. von dem in Schwarzweiß gedrehten Silvester-Sketch "Dinner for One" auch eine Farbversion. Das wäre nach Deiner Aussage grundsätzlich aus angeblich physikalischen Gründen aber gar nicht möglich, da diese Farbinformation unwiederbringlich verloren ist. Jetzt erkläre mir mal, wieso es diese Farbversion dann trotzdem gibt? Anscheinend war halt doch die Information noch da, dies zu tun. Wenn ihr glaubt, man kann aus einem Bild nicht mehr Informationen rausziehen, als augenscheinlich drinstecken, dann liegt ihr einfach falsch. Es gibt auch andere Stellen, an denen man ansetzen kann. Hier mal ein Beispiel. Achtung: jetzt wird es etwas theoretisch und geht in die digitale Bildverarbeitung rein. Ich versuche das trotzdem möglichst anschaulich zu beschreiben, aber ein paar Dinge sind einfach so, auch wenn man sich das als Laie, der sich noch nicht ausführlich mit digitaler Siganlverarbeitung (mathematisch gesehen) befasst hat, etwas anders vorstellt. Wie hier ja schon völlig zurecht gesagt wurde, kann man auch eine Runterskalierung, also die Verkleinerung eines Bildes, mit verschiedenen Algorithmen machen. Eine "korrekte" und sehr gute Skalierung würde das Bild mit einer FFT (Fast Fourier Transformation) oder ähnlichem ins Frequenzspektrum umrechnen, dort die Skalierung durchführen und dann wieder ins Pixel-Farbspektrum zurückrechnen. In einfachen Fällen wird die Skalierung aber deutlich einfacher durchgeführt, indem einfach gewisse Pixelzeilen und -spalten weggelassen werden. Das Ergebnis ist lange nicht so gut, reicht aber für viele Zwecke völlig aus. Mit dieser Art der einfachen Skalierung hat man aber Artefakte ins Bild eingebracht, die rein von der Frequenzanalyse her so eigentlich nicht sein dürften. Es treten z.B. Farbabrisse auf, wo gleichmäßigere Verläufe sein müssten. Schaut man sich so ein Bild folglich wieder im Frequenzspektrum an, dann erzeugen diese Farbabrisse hohe Frequenzen, die so nicht da sein dürften. Denn für eine aliasingfreie Darstellung braucht es digitaltechnisch gesehen immer einen Tiefpass, der bei dieser Art der Skalierung sozusagen fehlte. (Anmerkung: das ist z.B. immer der Punkt, wieso viele Leute glauben, dass die halbe Abtastfrequenz doch gar nicht ausreicht, weil man viel zu wenige Samples hat um die maximale Frequenz darzustellen. Diese Leute vergessen immer den Tiefpass, der bei der Wiedergabe über das Signal gelegt werden muss. Ohne Tiefpass hätten sie recht, mit Tiefpass wird das Signal jedoch wieder korrekt auf die Maximalfrequenz gemappt und die Wiedergabe ist wieder perfekt. Letztendlich steht und fällt die Qualität einer solchen Wiedergabe mit der Qualität des Tiefpasses. Je schlechter der ist, desto mehr Aliasing-Effekte enthält das wiedergegebene Material.) Wenn man also weiß, dass das Bild herunterskaliert wurde, dann kann man sich diese Information mit den hohen Frequenzen zugute machen und das Bild nachbearbeiten und so tatsächlich aus einer unzureichenden Skalierung durch Weglassen von Pixeln eine deutlich besser skalierte Version machen. Oder -- und jetzt kommt der eigentliche Kniff -- wenn man die Information hat, dass das Bild herunterskaliert wurde, dann kann man sich die übriggebliebenen Frequenzen von der Skalierung zunutze machen, und bei einer erneuten Hochskalierung verwenden, Teile dieser ursprünglichen Information wiederherzustellen. Und das ist meiner Meinung nach der eigentliche Trick, der bei den ganzen 4K-Mastered-BluRays passiert. Die Firma Sony, die ja diese 4K-Mastered-Filme meines Wissens ausschließlich produziert, weiß natürlich, wie sie die Herunterskalierung auf 2K machen. Entsprechend wissen sie auch, was da für Aliasing-Effekte im finalen Signal auftreten können. In der 2K-auf 4k-Skalierung wird diese Information nun tatsächlich genutzt, einen Teil der ursprünglichen Information wiederherzustellen. Was also für den Laien so ein bisschen wie Zauberei klingt, ist von der Bildverarbeitung her gesehen gar nicht so magisch.

Nein, so einfach ist es dann doch nicht. Denn je weniger Information vorhanden ist, bzw. je mehr Information hinzuerfunden muss, desto stärker fällt es dann doch irgendwann auf, dass diese Information eben nicht originalgetreu ist. Man kann vielleicht 50% oder 100% dazuerfinden, aber bei bei größeren Schritten wird der Unsicherheitsfaktor einfach zu groß, das heißt die Fehlerquote wird einfach zu hoch. Auch wenn bei der Berechnung zum Teil solche mathematischen Effekte wie die Aliasingeffekte einer Runterskalierung genutzt werden können, ist der Rest, also diese Geschichte mit der Datenbank, insgesamt halt doch nur eine Heuristik, also ein Verfahren, das nicht immer optimal ist, aber üblicherweise gute Ergebnisse bringt. Je mehr hinzuerfunden wird, desto größer ist einfach die Chance, dass diese Heuristik daneben liegt. Auch hier eine Erklärung anhand eines Beispiels: Nehmen wir mal ein Graustufenbild mit 8 Pixeln Breite. In der Horizontalen überlagern sich dort die Frequenzen 1, 2 und 4 Hz (1 Hz = 1 Wechsel von hell nach dunkel und wieder hell über die Bildbreite, 2 Hz = 2 Wechsel über die Bildbreite, 4 Hz = 4 Wechsel über die Bildbreite). Mehr als 4 Hz sind in diesem Bild nicht möglich. Denn mehr als die Pixelabfolge hell-dunkel-hell-dunkel-hell-dunkel-hell-dunkel ist bei 8 Pixeln nicht möglich. Skaliert man das Bild nun runter auf 4 Pixel Breite, dann kann die höchste Frequenz darin nun nur noch 2Hz sein. Das heißt eine Verkleinerung im Frequenzbereich ist das Weglassen von hohen Frequenzen. Das heißt das runterskalierte Bild hat nun nur noch die Frequenzen 1 Hz und 2 Hz überlagert. Will man dieses Bild wieder auf 8 Pixel hochrechnen, müsste man "nur" eine Frequenz wieder hinzufügen, nämlich die 4 Hz. Das ist das, was so eine Bildbearbeitung heute ansatzweise schafft. Es erkennt also im Bild die Überlagerung von 1Hz und 2Hz, schaut in seine Datenbank und sieht dort, dass 80% der Bilder, die heruntergerechnet die überlagerten Frequenzen 1Hz und 2Hz ergeben, im Original aus den Frequenzen 1Hz, 2Hz und 4Hz bestanden. Es kann durchaus auch andere Originalbilder geben, die heruntergerechnet diese beiden überlagerten Frequenzen ergeben. So könnte beispielsweise ein Bild aus den Frequenzen 1Hz, 2Hz, 2.5 Hz und 3 Hz ebenfalls diese beiden Frequenzen ergeben. (Das ist jetzt nur aus dem Ärmel geschüttelt und mathematisch für dieses Beispiel sicher falsch, aber es geht um die Idee dahinter.) Wenn nun die Datenbank aussagt, dass diese Kombination aber nur in 2% der Fälle vorkommt, dann wird sich die Skalierung eben wegen der höheren Wahrscheinlichkeit für die erste Variante entscheiden und das Muster beim Hochrechnen durch die Frequenzen 1Hz, 2Hz und 4Hz ersetzen. Und damit würde das Bild in 80% der Fälle tatsächlich wieder korrekt hergestellt. Und hätte tatsächlich wieder mehr Informationen als in der kleinen Version. Kann keine so eindeutige Wahrscheinlichkeit gefunden werden, kann auch keine Texturersetzung stattfinden, weil es eben nicht häufig genug richtig wäre. Skaliert man beispielsweise das Bild noch weiter runter auf 2 Pixel Breite, enthält es nur noch die eine Frequenz mit 1 Hz. Um dieses Bild wieder auf die Originalgröße zu vergrößern, müsste man also die Frequenzen 2 Hz und 4 Hz "hinzuerfinden". Umgekehrt wird es aber einfach verdammt viele Muster geben, die beim Herunterskalieren dann nur noch 1 Hz als Ergebnis haben. Das heißt es gibt nun kein Muster mehr, das so eine eindeutig hohe Wahrscheinlichkeit besitzt, alle Muster sind in etwa gleich wenig wahrscheinlich. Es ist zu wenig Information da, um sich für eines der Muster halbwegs eindeutig entscheiden zu können. Hier einfach irgendetwas zu nehmen, wäre in den meisten Fällen falsch. So etwas kann dann also nicht mehr skaliert werden, ohne einen hohen Fehler zu erzeugen. Was folgt daraus? Man kann mit dieser Methode zwar kleinere Skalierungen durchführen, so dass der Fehler noch halbwegs gering bleibt. Aber je mehr man hinzuerfinden muss, desto größer wird die Chance für den Fehler und desto unmöglicher wird eine korrekte Vorhersage. Es ist einfach nicht möglich aus einem einzigen Pixel das gesamte Bild wiederherzustellen, die Möglichkeiten sind einfach zu viele. Aber man kann aus einem Pixel 2 oder 4 Pixel machen, ohne dass es die "Realität" zu stark verfälscht. Und so kann man auch aus einem SD-Bild ein sauber aussehendes HD-Bild machen. Oder aus einem 2K-Bild ein 4K-Bild.

Dann hast Du die RC nicht richtig eingestellt. Die Automatik greift viel zu stark ein. Das wirkt tatsächlich völlig übertrieben. Man muss das auf manuell und auf etwas dezentere Werte einstellen, dann ist die RC wirklich genial. Als ich damals 2011 meinen HX925 kaufte, da war das das erste Modell, wo diese Reality Creation eingebaut war. Ich hatte zuvor eigentlich noch gar nichts darüber gelesen. Als ich dann so mit meinem Bildparametern herumspielte, kam ich auch bei der Reality Creation vorbei. Und da war ich verblüfft, weil es das erste mal nicht nur ein Verstärken von vorhandenen Strukturen war, die einfach nur überschärft werden und dabei helle und dunkle Kanten erzeugen, sondern es waren wirklich neue Strukturen da. Ich hatte eine DVD eingelegt und sah auf der Haut eines Schauspielers Hautporen in einer Detailtreue, die da auf der DVD definitiv nicht in dieser Form da gewesen sein konnten. Daraufhin habe ich mich mit diesem Ding namens Reality Creation etwas mehr befasst und finde es eine der faszinierendsten Erfindungen der letzten Zeit, was die Bildbearbeitung angeht. Völlig interessant wird die RC, wenn es um feine Strukturen geht. Wie z.B. Kopf- oder Barthaare. Da sieht man meiner Meinung nach sehr schnell, was eine Skalierung kann. Jede reine Skalierung kann solche feinen Strukturen eben nicht verbessern. Haare werden immer eine Art Pixelmatsch, wenn man sie einfach nur vergrößert. Schaltet man hier aber die RC ein und aus, dann staunt man, was sie aus solchen Haarstrukturen an Details rauszaubern kann. Das gilt schon für meinen 2K-TV, aber noch viel mehr bei den 4k-TVs. Wir hatten neulich wie gesagt Star Wars Episode 3 auf dem 4K-TV gesehen, wohlgemerkt von einer DVD. Das heißt das Bild musste von 720x576 Pixeln auf 3840x2160 Pixel hochgerechnet werden, also mal locker auf das 20-fache. Und dann habe ich mir den Bart von Ewan McGregor alias Obi Wan Kenobi angeschaut. Das war traumhaft, wie fein und detailliert die einzelnen Barthaare aussahen. Das *kann* so nicht auf der DVD draufgewesen sein. Und solche Dinge zeigen, was heute möglich ist.

Das ist völlig korrekt und solche unterschiedlichen Szenen spielen auch tatsächlich eine Rolle. Eine Technik wie die Reality Creation funktioniert ganz sicher auch nicht in allen Situationen gleich gut. So weit will ich gar nicht gehen. Ich hatte selbst nun schon zweimal den Fall, dass auf der ARD relativ alte digitale Abtastungen von sehr stark verrauschten Vorlagen gesendet wurden. Dieses Rauschen wurde von der Reality Creation gnadenlos durch die Datenbank gejagt und in ziemlich unschön anzusehende Pixelmuster verstärkt. Bei diesen Sendungen half es nur, die Reality Creation abzuschalten. Genauso wird ein Film, der bewusst Filmkorn als Gestaltungsmittel einsetzt, für die Reality Creation nicht geeignet sein. Entweder das gewollte Rauschen wird von dem Rauschfilter, der der RC vorgeschaltet ist, glattgebügelt, oder wie bei der verrauschten ARD-Vorlage in grob sichtbare Pixelmuster umgesetzt, was beides nicht gut aussieht und nicht gewollt ist. Interessant ist aber, dass mir solche Probleme in Realfilmen bisher eigentlich erst zwei oder dreimal aufgefallen sind, seit ich meinen TV habe. Es gibt auch noch Probleme bei Grafiken, wie z.B. bei Texteinblendungen von Menüs der Zuspieler. Wenn mein externer Sat-Receiver seinen EPG als Lauftext ausgibt, ist meine RC schwer am kämpfen. Aber das wurde in späteren Versionen wohl schon erkannt und die RC kann auf reine Videoinhalte beschränkt werden. Das heißt ich bin mir wohl bewusst, dass die RC nicht immer perfekt arbeitet. Aber in der vielen vielen anderen Zeit hat sich die RC eigentlich immer als sinnvoller Helfer bewährt, der die Qualität des Bildes verbessert und nicht verschlechtert hat. Und das ist es doch worauf es ankommt und warum ich die RC als echte Bildverbesserung bezeichne.

Auch das ist sicher richtig. Schon seit den HD-Aufnahmen im TV gibt es dort andere Schminke als früher, sogenannte HD-Schminke. Das ist aber im Grunde auch nichts Neues. So wurden beispielsweise in Schwarzweißfilmen zum Teil Kleider angezogen, die völlig seltsame Farben hatten und wie niemand wirklich in der Realität rumgelaufen wäre. Wie z.B. rosa statt weiße Hemden. Warum? Weil diese Kleider einen besseren Schwarzweiß-Kontrast ergaben und der Regisseur das so haben wollte. So etwas wird zum Teil erst jetzt, wo man genau solche Schwarzweißfilme nachkoloriert, offensichtlich. Mit der Erfindung des Farbfilms musste man dann halt auch diese Kleidergewohnheiten anpassen und durfte eben nicht mehr übertreiben. Genauso ist es mit der Schminke heute. Da wurde übertrieben, weil man es sonst bei der schlechten Wiedergabequalität gar nicht gesehen hätte. Je höher die Auflösung aber wird, je besser die Wiedergabe allgemein wird, desto weniger muss und darf man mit solchen Dingen wie Kleidung oder Schminke übertreiben.

Aber da ist es dann doch nur eine Frage der Qualität der Aufnahmegeräte und der Fähigkeit der daran beteiligten Kameraleute. Es ist nicht grundsätzlich ein Problem der 4K-Technik. Gruß, Hagge |

|||||||||||||||||||

|

Nui

Inventar |

#56

erstellt: 06. Jun 2014, 11:55

|

||||||||||||||||||

Ist denn der standard scaler überhaupt gut?  |

|||||||||||||||||||

|

service

Inventar |

#57

erstellt: 06. Jun 2014, 12:05

|

||||||||||||||||||

Die Erklärung ist einfach, der Film ist x-beliebig durch einen Koloristen ohne jeglichen Bezug zum orginal nach dessen Vorstellungen eingefärbt worden. |

|||||||||||||||||||

|

hagge

Inventar |

#58

erstellt: 06. Jun 2014, 12:16

|

||||||||||||||||||

Spielt das eine Rolle? Wenn er nicht gut wäre und trotzdem in Verbindung mit der RC so eine Qualität rauskommt, kann es mit einer besseren Skalierung in Verbindung mit RC ja nur *noch* besser werden. Hagge |

|||||||||||||||||||

|

hagge

Inventar |

#59

erstellt: 06. Jun 2014, 12:30

|

||||||||||||||||||

Nein nein, ganz so ist es nicht. Da wird schon der Hauptanteil vom Rechner übernommen. Da wird das Bildmaterial analysiert und verschiedene Szenen berechnet. Der Mensch muss vorgeben, dass gewisse Bereiche hier und da das gleiche "Material" sind. Durch die verschiedenen Graustufen bei verschiedenen Lichtverhältnissen wird dann sehr eindeutig klar, was das für eine Farbe sein muss. Im Detail greift der Mensch dann noch korrigierend ein, oder gibt in ein paar Keyframes noch ein paar Werte vor. Aber es ist nicht so, dass da wie früher beim Handkolorieren einer dran sitzt und Frame für Frame die Farben nachmalt. Lustigerweise kam ja genau dadurch das mit den rosa Hemden raus. Bei einer Nachkolorierung eines Films bestand der Rechner darauf, dass dieses Hemd rosa sein muss. Entsprechende Nachforschungen in den Filmarchiven mit Farbfotos vom Filmset bestätigte das dann, dass der Schauspieler tatsächlich ein rosa und kein weißes Hemd anhatte. Das heißt zu 98% macht hier der Rechner die Arbeit. Nachdem der Mensch gewisse Anfangsvorgaben gemacht hat, kann der Rechner aus dem Schwarzweißbild sehr wohl die Farbinformationen zurückrechnen. Laut Deiner Aussage ist so etwas aber grundsätzlich und physikalisch unmöglich. Ich will ja gerade darauf hinaus, dass Du erkennst, dass Deine Aussage einfach nicht stimmt. Steckt man ein paar Zusatzinformationen mit in das System hinein, wie z.B. die Datenbank der Reality Creation, kann es halt sehr wohl sein, dass man einen guten Teil der Information wieder restaurieren kann. Würde der Mensch bei der Reality Creation so wie bei der Nachkolorierung noch korrigierend mit eingreifen, wäre noch viel mehr möglich! Du wirst sehen, dass es in Zukunft auch Filme in 4K geben wird, zu denen es gar keine so hochauflösenden Quellen mehr gibt. Ein Teil davon wird mehr schlecht als recht aussehen, aber ein guter Teil wird mit hervorragender Qualität in 4K kommen. Und glaube nicht, dass das einer von Hand macht. Das wird im wesentlichen gerechnet und hier und da korrigierend eingegriffen. Aber auch das zeigt, dass es schon grundsätzlich möglich ist, mehr Informationen aus den Bildern herauszukitzeln. Gruß, Hagge [Beitrag von hagge am 06. Jun 2014, 12:33 bearbeitet] |

|||||||||||||||||||

|

service

Inventar |

#60

erstellt: 06. Jun 2014, 16:34

|

||||||||||||||||||

Nicht Frame by Frame sondern szenenweise, wie bei jeder gewöhnlichen Farbkorrektur.Der Rechner hat gewisse Tracking-Funktionen und nutzt die Korrelation für die Bearbeitung in den einzelnen Szenen.Der letztendliche Look liegt jedoch im ermessen des Coloristen. |

|||||||||||||||||||

|

Nui

Inventar |

#61

erstellt: 06. Jun 2014, 16:40

|

||||||||||||||||||

Wenn der RC verwendet, skaliert er doch anders, und das sonstige Skalierungsverfahren kommt evtl garnicht zu tragen. Du hast beschrieben, dass er ohne RC noch Treppenbildung in diagonalen Linien aufweist. Das können manche Verfahren auch so schon beseitigen. Vielleicht war "ohne RC" keine gute Referenz zum Vergleich? Das war mein "Einwand".  Mich interessiert an der Stelle eigentlich nur, ob ich hier auch häufig Fehler entdecken würde oder nicht. |

|||||||||||||||||||

|

hagge

Inventar |

#62

erstellt: 07. Jun 2014, 08:29

|

||||||||||||||||||

Das ist ja dann letztendlich egal. Es heißt einfach nur, dass man in so einem einzelnen Bild sehr wohl vollautomatisch aus dem Schwarzweißbild ein Farbbild berechnen kann. Dass man möglicherweise für eine *optimale* Farbverteilung die Hilfe des Menschen braucht, mag ja sein. Aber offensichtlich reicht auch dann eine sehr geringe Menge an Zusatzinformationen, um es dann sogar völlig "korrekt" zu machen. Das heißt die Information im Schwarzweißbild, trotz komplett entfernter echter Farbinformation, reicht (zumindest nahezu) aus, die komplette Farbinformation wiederherzustellen. Genau das ist es doch, was ich die ganze Zeit sage: es steckt mehr Information im Bild, als viele denken und die reicht auch dazu, gewisse Anteile eines höheraufgelösten Bildes zu restaurieren. Und das hast Du rigoros dementiert. Niemand sagt, dass man *alles* wiederherstellen kann, aber für gewisse Anteile reicht es. Und genau das ist dann der gewisse Schritt mehr als nur die reine Skalierung. Oder noch ein anderes Beispiel. In einem Fernsehbild ist sicher jedwede 3D-Information verloren gegangen. Meint man. Und dennoch schaffen es die 2D-auf-3D-Konvertierer im TV, auch aus einem 2D-Bild einen gewissen 3D-Effekt zu erzeugen. Natürlich ist das lange nicht so gut wie bei echtem 3D (so wie ein intelligent skaliertes Bild nie so gut wie das Original sein wird), aber bei manchen guten TVs ist zumindest szenenweise der Effekt schon ganz beeindruckend und enthält auf jeden Fall mehr Tiefe als das reine 2D-Bild. Ich weiß dass dieser letzte Vergleich jetzt manche zu dem Kommentar verleiten wird: "Und siehst Du, dieses erzeugte 3D ist unbrauchbar und das tue ich mir nicht an, also taugt das Verfahren nichts," Aber bitte bedenkt in welchem Zusammenhang ich das erwähne. Es geht darum, dass der TV aus einem reinen 2D-Bild, also rein aus den Daten, die keinerlei 3D-Informationen mehr enthalten,genau diese 3D-Informationen wiederherstellen muss. Und das klappt definitiv bis zu einem gewissen Grad. Der TV kann also gewisse Informationen wiederherstellen, die entfernt waren. Und das ist wieder genau der Punkt, wo hier einige vehement abgestritten haben, dass so etwas möglich ist. Aber wie man sieht, ist es sehr wohl möglich. Zugegeben nur bis zu einem gewissen Grad aber es ist definitiv mehr als im Ausgangsbild. Und mehr braucht es nicht um zu zeigen, dass eine echte Auflösungserhöhung mit echt mehr Information als im Ausgangsbild durchaus im Bereich des Möglichen ist. Gruß, Hagge |

|||||||||||||||||||

|

Nui

Inventar |

#63

erstellt: 07. Jun 2014, 08:40

|

||||||||||||||||||

Es ist nicht vollautomatisch, wenn der Mensch die Farbe vorgeben muss. Die originale Information ist weg. Die Wandlung von RGB zu greyscale ist eindeutig, aber anders rum einfach nicht.

Hast du einen Link zu einem solchen automatisiertem Verfahren?

Stimmt. Man kann aus clues und auf Basis von Annahmen Informationen hinzudichten. Fehlerhaft. Genau wie man Zwischenbildberechnungen für flüssigere Bilder errechnen kann. Fehlerhaft. In beiden Fällen sind Informationen einfach verloren gegangen, aber das hast du ja auch selbst geschrieben. Ich hab kein Problem RC in die gleiche Kategorie wie diese Verfahren zu stecken. Aber dann würde ich auch das nicht verwenden  [Beitrag von Nui am 07. Jun 2014, 08:41 bearbeitet] |

|||||||||||||||||||

|

Supermario

Inventar |

#64

erstellt: 07. Jun 2014, 12:01

|

||||||||||||||||||

|

Es ist doch ganz einfach. Wenn hagge und natürlich auch jeder Andere z.B. das Bild auf TV xy-UHD gut findet dann kann man das ja hier im Forum berichten und auch sagen was gut gemacht wurde, wie Skalierung usw., aber es sollte dann für alle Anderen, vor allem Personen die hier mitlesen und nicht so mit der Materie vertraut sind, gesagt werden dass das Ergebnis nicht dem Original entspricht. Denn es sollte keinem beigebracht werden diese Verfälschungen, auch wenn sie sehr gut aussehen, grundlegend als das bessere oder die richtige Methode anzusehen. Man muss sich dann selbst eine Meinung bilden ob man die ein oder andere Eigenschaft eines TV sogar besser findet wie das Original, genausogut oder schlechter. Vielleicht sollten wir uns angewöhnen Beiträge zu schreiben als wären es fachmännische Reviews ohne vom Hersteller des Gerätes geschmiert worden zu sein.  |

|||||||||||||||||||

|

Nudgiator

Inventar |

#65

erstellt: 08. Jun 2014, 00:25

|

||||||||||||||||||

Preisfrage: welche Scaler hast Du denn bisher getestet ? |

|||||||||||||||||||

|

hagge

Inventar |

#66

erstellt: 08. Jun 2014, 08:08

|

||||||||||||||||||

Na ganz so ist es ja nicht. Wenn man eine gewisse Graustufe im Bild hat, dann können natürlich sofort gewisse Farben ausgeschlossen werden, weil diese im Schwarzweißbild andere Graustufen ergeben hätten. Es bleibt also eine gewisse Ungewissheit, aber der mögliche Farbbereich ist nicht völlig unbekannt. Der Rest steht und fällt mit der Fähigkeit, den Inhalt des Bildes zu erkennen. Das kann heute halt nur der Mensch perfekt, aber wer sagt, dass das auf immer so bleiben muss? Hier werden ja auch gewaltige Fortschritte gemacht. Heute wird es z.B. schon als völlig normal angesehen, dass ein Fotoapparat erkennt, wo im Bild Gesichter sind und sogar, ob diese lächeln. Das heißt spätestens wenn die Bilderkennung noch einen Schritt weiter ist, geht hier noch deutlich mehr vollautomatisch. Das heißt nur weil es heute noch nicht zu 100% vollautomatisch geht, heißt das nicht, dass diese Information nicht dennoch im Bild steckt und nur heute noch nicht ausgewertet werden kann. Außerdem ist das für mich sozusagen schon praktisch vollautomatisch, wenn der Mensch einmal zu Beginn einer Szene ein paar Farben vorgibt und der Rechner daraufhin die komplette Szene einfärbt. Denn das Entscheidende ist, dass er in jedem Bild selbständig die Objektgrenzen findet, erkennt, von wo nach wo sich Objekte bewegen, etc. Nachdem ich gestern darum extra nochmal ein bisschen im Internet zum Thema Nachkolorieren gelesen habe, ist wohl das Hauptproblem, den Grundton der Farbe zu finden. Es gab wohl Aufzeichnungen, wo zwar eine PAL-Farbkamera zum Einsatz kam, aber dennoch nur in Schwarzweiß aufgezeichnet wurde. In diesen Schwarzweißaufzeichnungen hat das PAL-Farbsignal wohl gewisse Artefakte im Schwarzweißbild hinterlassen, die man heute heranziehen kann, um den Farbquadranten zu bestimmen. Und in diesen Fällen gelingt die Einfärbung wohl vollautomatisch.

Siehe z.B.  http://colourrecovery.wikispaces.com/. Mit solchen automatisierten Verfahren konnten z.B. einige Folgen von "Dr. Who" und anderer Serien erfolgreich nachgefärbt werden. http://colourrecovery.wikispaces.com/. Mit solchen automatisierten Verfahren konnten z.B. einige Folgen von "Dr. Who" und anderer Serien erfolgreich nachgefärbt werden.

Halt, stopp. Sind diese Informationen wirklich fehlerhaft? Oder nur nicht ausreichend? Das wäre nämlich ein ganz relevanter Unterschied.

Vielleicht muss man es echt mal gesehen haben, um das zu entscheiden. Ich glaube, wenn da nun völlig falsche Dinge rauskämen, würde es wohl kaum jemand nutzen. Das entscheidende ist, dass es wirklich besser aussieht und darum nutzen es fast alle User, deren TV diese Reality Creation enthält.

Ich denke ich habe schon oft genug gesagt, dass es bei Reality Creation überwiegend auf Realität und nicht auf Originalität ankommt. Dass das aber in den meisten Fällen ausreicht.

Ich interpretiere das mal als Seitenhieb auf mich. Aber wie soll man es denn anders schreiben, wenn es nur ein Verfahren gibt, das das so macht? Oder kennst Du ein anderes Scalingverfahren, das ähnlich wie die Reality Creation vorgeht? Außerdem denke ich, dass so ein Verfahren halt nicht mit 3 Sätzen erklärt ist. Viele Leute hier haben ja auch naturgemäß keine zwei Semester Digitale Bildverarbeitung studiert, wie sollen sie also verstehen, was man aus einem Frequenzbild alles herauslesen kann? Manche Dinge erscheinen dann dem Laien wie Zauberei und damit unwahrscheinlich, während er sich bei anderen Dingen wundert, warum man da nicht schon länger irgendwelche Fortschritte gemacht hat. Insofern hoffe ich, dass meine Ausführungen eben gerade *nicht* als Lobhudelei auf Sony durchgehen, sondern ganz gezielt nur die Arbeitsweise dieser Reality Creation beleuchten und versuchen zu erklären, die es sozusagen nur zufällig halt von Sony gibt. Ich versuche bewusst, den Firmennamen nicht zu oft zu nennen, aber am Namen der Bildtechnik kommt man ja wohl nur schwer vorbei, wenn man sie beschreiben will. Gruß, Hagge [Beitrag von hagge am 08. Jun 2014, 08:12 bearbeitet] |

|||||||||||||||||||

|

Nudgiator

Inventar |

#67

erstellt: 08. Jun 2014, 10:06

|

||||||||||||||||||

|

Nur so am Rande: Reality Creation hat absolut nichts (!) mit Scaling zu tun ! |

|||||||||||||||||||

|

service

Inventar |

#68

erstellt: 08. Jun 2014, 10:08

|

||||||||||||||||||

Das funktioniert doch nur weil sich innerhalb einer Szene der Informationsgehalt kaum ändert, so ähnlich wie die GOP-Struktur (Group of Picture) bei MPEG.Das ist nicht vollautomatisch im Sinne von schnell, da werden unzählige Varianten durch menschliche Eingriffe probiert und immense Zeit aufgewendet um ein akzeptables Ergebnis zu erhalten. |

|||||||||||||||||||

|

service

Inventar |

#69

erstellt: 08. Jun 2014, 10:46

|

||||||||||||||||||

Das Palsystem hatte keine eindeutige Trennung zwischen Crominance und Luminance, beides wurde in einem Kanal übertragen. Die Luminance ist die Basisinformation, kompatibel bis ca. 3,5 MHz zur Schwarz/Weiß-Übertragung. Die Chrominance ist mit einer Quadratur-AM mit unterdrücktem Träger von 4,43 MHz aufmoduliert. B-Y mit 0 Grad Phasenlage, R-Y mit + 90 Grad Phasenlage das zeilenweise noch um 180 Grad geschaltet wurde. Wenn Farbinfo im Luminance-Kanal vorhanden waren, ist das durch die Unzulänglichkeit des Verfahrens bedingt. Heutige Verfahren arbeiten hingegen mit getrennten Y, R-Y ,B-Y Kanälen. |

|||||||||||||||||||

|

Supermario

Inventar |

#70

erstellt: 08. Jun 2014, 15:17

|

||||||||||||||||||

Der Satz von mir war eher allgemein gehalten. Auch ich hab mich früher schon erwischt wenn ich irgendwas ganz toll fand, unbedingt wollte das auch Andere das toll finden und hab halt vergessen objektiv zu bleiben. Dein Beitrag wo du die RC von Sony genauer erklärst war schon ziemlich so wie ich das gemeint hab. Dort hast du ja gesagt das nicht immer richtig abgeschätzt wird ob und wenn ja welche Textur aus der Datenbank genommen wird und dadurch auch Fehler entstehen können. Die ersten Beiträge wo du von dem screening berichtet hast und wie toll der 4K TV skaliert, haben sich eher so angehört: "Boah ey der Sony skaliert voll geil, den müsst ihr euch alle holen, dat is besser wie jeder FullHD TV!", etwas übertrieben dargestellt. Aber so hätte ein unbedarfter Forenuser das evtl. interpretieren können. Ist ungefähr so als wenn ich einen Plasma getestet hätte und dann im Review schreibe, der hat kein sichtbares Linebleeding mehr, und der nächste der sich den TV kauft sich bei mir beschwert, weil das mit dem Linebleeding viel zu auffällig wäre und was ich mir einbilde sowas zu schreiben. Wenn ich aber schreibe das Linebleeding bei TV XY ist bei Testbild AB um ca. 20% niedriger wie beim Vorgänger und 30% weniger wie beim Konkurenzprodukt, dann kann sich der Leser seine eigene Meinung bilden. |

|||||||||||||||||||

|

Nui

Inventar |

#71

erstellt: 08. Jun 2014, 20:27

|

||||||||||||||||||

Aber die Information ist weg. Es kann sich bei Grautönen prinzipiell sogar um den genauen Grauton, bis hin zu reinem Rot, Grün oder Blau handeln, der Farbbereich ist also eigentlich kaum eingeschränkt. Die Information ist weg. Ich verstehe wirklich nicht, wie du darauf kommst, dass die Information noch vorhanden wäre. Heuristiken und Annahmen erlauben es uns eindeutige Entscheidungen zu treffen, die vielleicht sogar "häufig" gut sind, aber bis zu horrend daneben liegen können. Und hier meine Meinung dazu: Aus den genannten Grund interessieren mich solche Verfahren nicht. Ich investiere nicht Zeit und Geld, um eine möglichst saubere Darstellung zu erhalten nur um dann das Bild stellenweise wieder kaputt zu machen

Selbst der kann das nicht.

Im Bereich TV hilft uns das natürlich überhaupt nicht. Zumal der Mensch immernoch kontrollieren muss, ob das Verfahren die von dir genannten Punkte wirklich zufriedendstellend erreicht hat und evtl eingreifen. Natürlich in keinster weise vollautomatisch, selbst wenn der Mensch nur zu Beginn eingreifen müsste

Witzig und hatte ich auch selbst gefunden, aber leider irrelevant. Die Farbinformation ist an dieser Stelle wirklich nicht ganz verworfen worden, sie ist noch spärlich vorhanden.

Nicht grundsätzlich, aber sie können natürlich Fehlerhaft sein. Man überlege sich einfach verschiedene Bewegungen die nach Reduktion auf 24p das gleiche Ergebnis produzieren. Nun wird eine Rekonstruktion versucht und kann grundsätzlich ein falsches Ergebnis erwischen, weil es immer Alternativen gibt.

Die Bewertung nach korrekt/falsch und gefallen/nicht-gefallen sind sowieso zwei paar Schuhe und letzteres ist rein subjektiv

Ich bin mir nicht sicher, ob "Realität" besser erreicht werden kann als "Originalität". |

|||||||||||||||||||

|

-Didée-

Inventar |

#72

erstellt: 09. Jun 2014, 01:10

|

||||||||||||||||||

|

Die "Analogie" zwischen RealityCreation und S/W-->Farbe ist ganz grundsätzlich ausgesprochen schwach. Wenn ein Vergleich "hinkt", dann dieser. Um so ermüdender, in einem Thread über 2k->4k Skalierung seitenweise Argumentationen über automatisierte S/W-Colorierung lesen zu müssen. Ihr könnt auch noch weitere 4 oder 5 Seiten über das Colorierungs-Problem diskutieren, mit der Skalierungs-Frage hat das nichts, aber rein gar N-I-C-H-T-S zu tun ...  Die jeweilige Problemstellung ist von völlig anderer Art. Die jeweilige Problemstellung ist von völlig anderer Art.Fangen wir nochmal an mit dem "Datenbank-basierten dazu-Erfinden von Detail" durch Sony's RC, was großer Quatsch & Unsinn ist, aber aus einer bestimmten Ecke heraus gerne so argumentiert wird ... Ich mag duchaus das, was die RC tatsächlich macht ... aber bei den bisweilen zu lesenden Begründungen/Argumentationen krieg' ich furchtbare Nackenschmerzen, vor lauter traurigem Kopfschütteln.  |

|||||||||||||||||||

|

Nudgiator

Inventar |

#73

erstellt: 09. Jun 2014, 01:13

|

||||||||||||||||||

|

Versuch es doch mal mit eigenen Worten  |

|||||||||||||||||||

|

hagge

Inventar |

#74

erstellt: 09. Jun 2014, 08:32

|

||||||||||||||||||

Richtig. Aber es kommt doch darauf an, wie oft das passiert.

Du verstehst den Punkt nicht, auf den ich mit dieser ganzen Nachkolorierung raus will. Selbst wenn heute da der Mensch noch eingreifen muss, kann es doch gut sein, dass in 10 oder 20 oder wegen mir auch erst in 50 oder 100 Jahren so etwas völlig automatisiert gehen kann. Dennoch steckt aber doch dann nicht mehr Information in dem Bild als heute. Es ist also nur eine Frage, ob man diese Information rauskitzeln kann und welchen Aufwand man dafür treibt. Ein Teil dieser zusätzlichen Information, die eine solche Bildbearbeitung aus einem Bild herauskitzelt, kann also sehr wohl zu 100% korrekt sein. Die Aussage, dass es also physikalisch unmöglich ist, gewisse Informationen wiederherzustellen, so wie es service formulierte, ist also in der Stärke nicht gültig. Man kann sicher nicht alles wieder restaurieren, aber einen Teil sehr wohl. Wobei der Aufwand, gewisse Teile wiederherzustellen, sehr hoch sein kann.

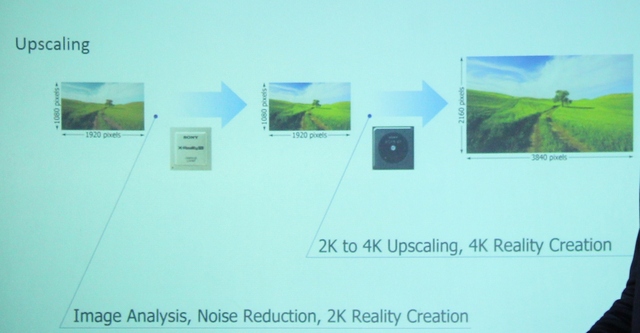

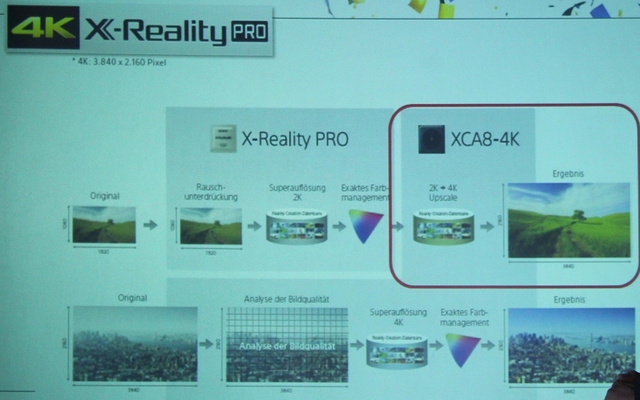

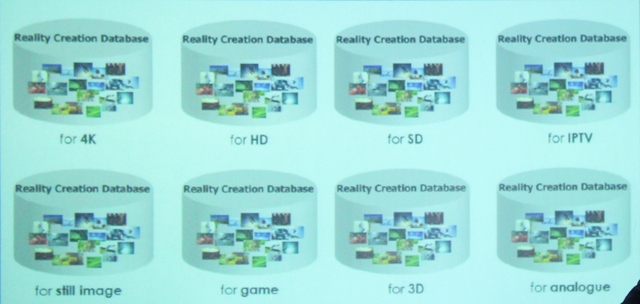

Sondern? Versuch es doch mal mit eigenen Worten...  Sagen wir's mal so: die RC ist die Ersetzung von niedrig auflösenden Frequenzpatterns durch hochauflösende Frequenzpatterns. Natürlich kann so etwas auch eingesetzt werden in nichtskalierten Bildern. Man könnte also auch in einem HD-Bild (oder auf dem 4K-TV in einem 4K-Bild) solche Ersetzungen durchführen und tatsächlich kann man die RC auch bei solchen nichtskalierten Bildern aktiviert lassen. Aber mal ehrlich, da macht so eine Ersetzung doch relativ wenig Sinn. Das heißt der Hauptzweck dieser Ersetzung wird eben bei der Skalierung sein. Insofern kann man die RC schon bis zu einem gewissen Grad der Skalierung zurechnen und das Ergebnis ist ja genau das, was hier schon "intelligente Skalierung" genannt wurde. Ich kann gerne auch nochmal die Technik etwas mehr im Detail erklären und ein paar Bilder von einer Präsentation beifügen. Die Bilder sind nicht so toll, sie sind von einer Rückpro-Leinwand abfotografiert und waren perspektivisch verzerrt, was ich allerdings nun schon mit GIMP etwas ausgeglichen habe. Egal, man sieht das Prinzip. Bei der 4K-Version der X-Reality-Engine kommen wohl zwei getrennte Chips zum Einsatz. Der erste Chip heißt XC7, bestand früher wohl selbst schon aus zwei Chips, die nun in einen vereinigt wurden, und macht wie bei den bisherigen Full-HD-Fernsehern schon eine grundsätzliche Bildverbesserung auf Full-HD-Basis. Also ggf. Hochskalierung von kleineren Auflösungen (z.B. Internetvideos, SD-Auflösung), dann Bildanalyse, Rauschreduzierung, und datenbankbasierte 2K-Reality-Creation. Der zweite Chip heißt dann XCA8-4K und der führt dann die Skalierung auf 4K durch. Und hier kommt *wieder* eine Datenbank vor, also eine Art 2K-auf-4K-Reality-Creation.    Im Prinzip wird die Bildaufbereitung immer für die gerade vorliegende Situation optimiert: für 4K, für HD, für SD, für IPTV, für Fotos, für Spiele, für 3D, für analoges Bild. Es kommen wohl sogar entsprechende angepasste Datenbanken zum Einsatz:

Mir ging es ja nicht um einen Vergleich der Techniken, sondern um ein weiteres Beispiel dafür, dass in einem Bild weit mehr Information drin steckt, als man im ersten Moment denkt und dass es eben nicht zwangsweise bedeuten muss, dass man Information hinzuerfindet, sondern dass man gewisse Informationen nur wieder restauriert. Das ist ein Schritt, den ich ggf. der RC andichte, wenn sie Material, das von 4K auf 2K runtergerechnet wurde, wieder auf 4K hochskaliert. Das schließe ich daraus, dass hier schon vom Hersteller selbst mehrfach gesagt wurde, dass gewisse Dinge nicht mehr funktionieren, wenn es eben kein herunterskaliertes Bild ist. Der zweite Schritt ist dann wirklich das "Hinzuerfinden", also das Ersetzen von niedrig auflösenden Strukturen durch höher auflösende Strukturen mit Hilfe einer Datenbank.

Ich weiß dass Du bei diesem Punkt ein extremer Skeptiker bist. Aber nur weil *Du* es nicht glauben willst, kann es dennoch so sein, dass Datenbanken vorkommen. Denn wieso sollte die ganze Bildaufbereitung vom Hersteller so erklärt werden und an mehreren Stellen eine Datenbank erwähnt werden, wenn überhaupt keine Datenbank dabei wäre? Und nicht nur das, die ganze Sache mit der Datenbank macht doch durchaus auch Sinn! Ich hatte Dir auch schon an anderer Stelle  diesen Beitrag gepostet, bei dem die Entwickler dieser Technik selbst zu Wort kommen. Und auch die sprechen von Datenbanken, deren Austausch und Weiterentwicklung, usw. Warum Du das nicht glauben willst und ständig gegen diese Formulierung wetterst, ist mir ein Rätsel. diesen Beitrag gepostet, bei dem die Entwickler dieser Technik selbst zu Wort kommen. Und auch die sprechen von Datenbanken, deren Austausch und Weiterentwicklung, usw. Warum Du das nicht glauben willst und ständig gegen diese Formulierung wetterst, ist mir ein Rätsel.Ob man das nun "Dazuerfinden" nennt, darüber kann man streiten. Ich sehe es eher anders, aber es gibt halt viele Leute, die eine nicht-eindeutige Ersetzung als "Hinzuerfinden" bezeichnen und es aus diesem Grund ablehnen. Siehe Nui. Gruß, Hagge [Beitrag von hagge am 09. Jun 2014, 08:46 bearbeitet] |

|||||||||||||||||||

|

Nui

Inventar |

#75

erstellt: 09. Jun 2014, 08:53

|

||||||||||||||||||

Selbst der Mensch kann es nicht korrekt. Die Informationen sind weg. Es werden immer nur Heuristiken bleiben, die keine Informationen "herauskitzeln", sondern möglicherweise falsche Annahmen verwenden um Entscheidungen zu treffen.

Und es lässt sich garnichts mit Sicherheit wiederherstellen. Klar können Dinge zu 100% korrekt sein, aber auch zu 0% und du als Nutzer wirst es beim schauen nicht mal wissen. Aber diese Diskussion führt zu nichts, also würde ich mich ganz gerne ausklinken  |

|||||||||||||||||||

|

Supermario

Inventar |

#76

erstellt: 09. Jun 2014, 09:50

|

||||||||||||||||||

|

Also die Informationen die verlorengingen beim skalieren oder S/W Filmen könnte man schon wieder herstellen. Dafür müsste man aber einen Weg finden die Heisenbergsche Unschärferelation zu überwinden um die Entropie des Universums zu bestimmen und dann zurückzurechnen bis zum Zeitpunkt der Aufzeichnung des Filmmaterials. Dann hat man alle Informationen wieder  Vielleicht gibts in 100 Jahren einen Scaler mit Heisenbergkompensator wie bei Star Trek  "nicht ganz ernst gemeint" |

|||||||||||||||||||

|

service

Inventar |

#77

erstellt: 09. Jun 2014, 10:04

|

||||||||||||||||||

Das sind doch nur gut aufbereitete Verkaufsprospekte, im Prinzip reine Produkt-Werbung. |

|||||||||||||||||||

|

Nudgiator

Inventar |

#78

erstellt: 09. Jun 2014, 11:40

|

||||||||||||||||||

Als ich das erste Mal etwas über "Reality Creation" gehört habe, gab es nur 2k-TVs und -Beamer. 4k war noch kein Thema. Die RC wurde also ursprünglich bei 2k-Material eingesetzt - nix mit Upscaling  [Beitrag von Nudgiator am 09. Jun 2014, 11:41 bearbeitet] |

|||||||||||||||||||

|

Joe-Han

Inventar |

#79

erstellt: 09. Jun 2014, 12:12

|

||||||||||||||||||

|

Nun, diese Werbeaussagen sind schon etwas entlarvend: "verstärkt Farben, Kontraste und Texturen", "Noise Reduction" etc. Das Bild mag zwar knackiger, perfekter aussehen. Es entfernt sich aber unweigerlich vom Original; vom Master, dass der Regisseur mal so abgenickt und gewünscht hat. Wenn also bestimmte Farbverfremdungen, vielleicht auch Reduzierungen! eingesetzt wurden, um eine bestimmte Stimmung zu erzeugen, so fallen sie ebenso der Bildverschlimmbesserung zum Opfer, wie vielleicht das künstliche Filmkorn in 300 oder der Nebel von Silent Hill einer "Noise Reduction". Die digitale Nachverarbeitung kann NIE zu 100% wissen, was gewollt oder natürlich ist. Das ist IMHO wie bei den Darbee-Produkten: Je mehr Bildverbesserung, desto weniger orginalgetreu. Das erzeugt dann z.B. auch Kriegs- oder Horrorfilme mit poppigen Farben. |

|||||||||||||||||||

|

Nudgiator

Inventar |

#80

erstellt: 09. Jun 2014, 12:21

|

||||||||||||||||||

|

Darbee-Produkte & Co sollte man daher mit maßvollen Einstellungen betreiben. Davon profitiert das Bild ohne Generierung von Artefakten. |

|||||||||||||||||||

|

MarcWessels

Inventar |

#81

erstellt: 09. Jun 2014, 20:56

|

||||||||||||||||||

|

Kommt wohl darauf an, wie streng man die Definition von "Artefakt" ansetzt. |

|||||||||||||||||||

|

Nudgiator

Inventar |

#82

erstellt: 09. Jun 2014, 21:34

|

||||||||||||||||||

|

Ganz einfach: wenn ich keine Artefakte auf Testbildern sehe und auch messtechnisch nichts erfassen kann, rede ich von artefaktfrei. Aber jetzt bitte keine Grundsatzdiskussion über Sinn / Unsinn des Darbees. Ich bin bekannt dafür, daß ich i.d.R sämtliche "Bildverschlimmbesserer" ausschalte. Einzige Ausnahme: Darbee mit MASSVOLLER Reglerstellung inkl. HD-Modus. |

|||||||||||||||||||

|

hagge

Inventar |

#83

erstellt: 10. Jun 2014, 05:58

|

||||||||||||||||||

Was anderes wird es wohl zu dem Thema nicht geben. Ich glaube nicht, dass sich die Entwickler detaillierter zu der Thematik äußern als sie es in dem von mir genannte Link tun und uns gar den endgültigen Algorithmus präsentieren. Das dürfte aber bei anderen Firmen nicht anders sein.

Doch, gerade da ging es um Upscaling von SD auf 2K. Dazu wurde die X-Reality PRO immer schon damit beworben, dass sie auch besonders gut sei, selbst Internetinhalte wie YouTube-Videos mit sehr geringer Auflösung besonders gut hochskalieren zu können, ja dass genau deswegen der (damals auch bei 2K noch) zweite Chip bei der PRO-Lösung verbaut sei. Kann denn hier wirklich niemand das Potenzial dieser intelligenten Skalierung erkennen und schätzen? Ich denke mit den hier schon genannten normalen Skaliermethoden ist halt nun das Ende der Fahnenstange erreicht. Mehr als eine Superresolution ist wohl nicht mehr drin. Nur mit solchen intelligenten Lösungen kann man diese Schwelle noch überschreiten. Und auch wenn manche hier momentan noch skeptisch sind, werden solche Systeme in der Zukunft sicherlich Standard werden und jeder wird es ganz selbstverständlich einsetzen. Und so ein System ist halt meiner Meinung nach nicht mit drei Sätzen erklärt. Zumal ja selbst bei Leuten, die sich doch schon recht intensiv mit der Bildthematik beschäftigt haben, einiges an Skepsis herrscht. Darum mein Tipp: schaut euch das selbst mal an. Aber bitte nicht die Automatik aktiviert lassen, sondern RC auf manuell schalten (Taste Options -> Bild -> RC). Es gibt dann zwei Werte: die Auflösung und den Rauschfilter. Ich fahre ganz gut mit einer Auflösung von etwa 25 und einem Rauschfilter von 10, den Szenenmodus möglichst auf Kino stellen (Taste Options -> Szene -> Kino). Und dann mal entsprechende Filme mit niedriger Auflösung anschauen (also SD-Quellen bei 2K-Geräten und 2K-Quellen bei 4K-Geräten) und das Ergebnis vergleichen, indem man die RC ein- und ausschaltet. Neulich bei der Formel 1 habe ich mal wieder besonders drauf geachtet. Da ich es nicht einsehe, für werbeverseuchtes TV auch nur einen weiteren Cent zu zahlen und somit kein HD+ unterstütze, schaue ich die Formel 1 folglich ganz banal in SD auf RTL. Bei der Datenrate lässt sich während des Rennens auch RTL nicht lumpen und so saß ich wieder mal recht begeistert vor diesem genialen auf Full-HD hochskalierten SD-Bild. Selbst als Split-Screen-Werbung war, konnte man im verkleinerten Bild noch den Rundenzähler oben lesen. Bei dieser Skalierung braucht es wirklich kein HD+. Gruß, Hagge |

|||||||||||||||||||

|

service

Inventar |

#84

erstellt: 10. Jun 2014, 10:48

|

||||||||||||||||||

Die Konsequenz wäre dann, dank Sonys Reality Creation kann man jetzt alle HD-Sender wieder abschalten und zum SD zurückkehren.  |

|||||||||||||||||||

|

George_Lucas

Inventar |

#85

erstellt: 10. Jun 2014, 11:14

|

||||||||||||||||||

|

Das hat hagge doch gar nicht behauptet. Wir sind uns wohl alle einig darüber, dass ein vernünftiges Full-HD-Bildsignal auf einem Full-HD-TV besser aussieht als ein hochskalieres SD-Bildsignal. |

|||||||||||||||||||

|

service

Inventar |

#86

erstellt: 10. Jun 2014, 11:40

|

||||||||||||||||||

Hatte ich aber so verstanden.

|

|||||||||||||||||||

|

George_Lucas

Inventar |

#87

erstellt: 10. Jun 2014, 11:52

|

||||||||||||||||||

|

Das Zitat hast Du aber schon ein wenig aus dem Zusammenhang gerissen.  Hagge ist lediglich nicht bereit, für HD+ zusätzlich Geld zu bezahlen. Darüber hinaus reicht ihm das SD-Bild aus, wenn es auf Full-HD-Auflösung hochskaliert wird. Er schreibt nicht, dass das hochskalierte SD-Bild genau so gut ist wie das Originale-HD-Bild. Ist halt alles eine Frage der Prioritäten, der Bildgröße und der Ansprüche.

[Beitrag von George_Lucas am 10. Jun 2014, 13:07 bearbeitet] |

|||||||||||||||||||

|

hagge

Inventar |

#88

erstellt: 10. Jun 2014, 13:06

|

||||||||||||||||||

|

@George_Lucas Danke für die Unterstützung. Man kann sich hier die Finger wund tippen, es wird einem jeder Satz rumgedreht und ins Gegenteil verkehrt. @service Es ging hier in der ganzen Diskussion noch nie darum, dass eine skalierte Version eines Bildes besser oder auch nur annähernd so gut ist wie eine native höhere Auflösung. Niemand hat hier je gesagt dass skaliertes SD genauso gut ist wie HD, niemand hat je gesagt, dass skaliertes 2K-HD besser als 4K-HD ist. Es geht hier die ganze Zeit nur darum, dass ein skaliertes Bild auf einem Gerät mit höherer Auflösung besser aussehen kann als das unskalierte Bild auf einem entsprechenden nativen Gerät. Also dass SD auf einem 2K-HD-TV besser sein kann als SD auf einem SD-TV und dass skaliertes 2K-HD auf einem 4K-TV besser sein kann als 2K-HD auf einem 2K-TV. Einige hier haben das bezweifelt und es sogar als physikalisch unmöglich bezeichnet. Nicht zuletzt Du selbst. Viel von dem, was ich in den letzten Tagen hier geschrieben hatte, bezog sich als Folge dann erst einmal nur darauf, nachzuweisen, dass diese Aussage mit dem "physikalisch unmöglich" eben so nicht stimmt. Ich habe mir viel Mühe gegeben, dies bis hin zu Erklärungen anhand von Bildern im Frequenzraum zu erklären, und ich habe versucht, mit der Nachkolorierung und der 2D-nach-3D-Konvertierung andere Beispiele zu finden, wo es vielleicht offensichtlicher ist, dass man noch mehr Informationen aus einem Bild ziehen kann, als es der erste Anschein glauben lässt. Bisher habe ich noch keinerlei technische Begründung von Dir gehört, warum dies nicht möglich sein solle. Stattdessen aber immer sehr einseitige Auslegungen, die den Anschein erwecken, dass Du mich bewusst nicht verstehen willst und Du eher versuchen willst, meine Ansicht ins Lächerliche zu ziehen. Das finde ich schade, da Du Dich offensichtlich nicht etwas tiefergehend mit der Thematik befassen willst. Wenn dem so ist, dann sage es, dann können wir die Diskussion an dieser Stelle abbrechen. Wenn Du aber bereit bist, dem Thema noch etwas weiter zu folgen, könnte ich Dir noch ein weiteres Gedankenexperiment als Beispiel anbieten, wo Du vielleicht dann doch nachvollziehen kannst, dass es sehr wohl möglich ist, in ein hochskaliertes Bild mehr Informationen einzubringen, als das originale nichtskalierte Bild hatte. Gruß, Hagge |

|||||||||||||||||||

|

Nudgiator

Inventar |

#89

erstellt: 10. Jun 2014, 13:31

|

||||||||||||||||||

|

Sorry, George, aber ich sehe das so wie service. Das Zitat "Bei dieser Skalierung braucht es wirklich kein HD+" ist IMHO eindeutig und suggeriert, daß HD+ keine Vorteile gegenüber SD + RC bringt. Das ist mitnichten so, zumal man die RC ja auch bei HD+-Material nutzen kann. Damit will ich es auch belassen, da wir hier sonst wieder die gleiche, sinnlose Diskussion führen wie im Plasma vs. LCD/LED-Thread. Ich erinnere mich nur ungern an das Thema "Local Dimming". Manche Leute sind einfach unbelehrbar und wissen immer alles besser  |

|||||||||||||||||||

|

hagge

Inventar |

#90

erstellt: 10. Jun 2014, 16:56

|

||||||||||||||||||

|

@Nudgiator Bitte die Beiträge hier auch komplett lesen und sich nicht einfach an einen einzelnen Satz hängen und drauflosposten. Spätestens nach Beitrag #88 sollte klar sein, dass es so definitiv nicht gemeint war:

Was soll also dieser nachgeschobene Kommentar, nachdem das doch schon eindeutig geklärt war? Gruß, Hagge |

|||||||||||||||||||

|

service

Inventar |

#91

erstellt: 10. Jun 2014, 21:06

|

||||||||||||||||||

Besser aussehen ist rein subjektiv vom Empfinden des Betrachters abhängig, wissentschaftlich nicht bewertbar.Physikalisch hingegen erzeugt die Scalierung keinen Auflösungs- oder Mehrgewinn an Informationen. |

|||||||||||||||||||

|

service

Inventar |

#92

erstellt: 10. Jun 2014, 21:21

|

||||||||||||||||||

Die bessere, preiswertere Alternative wäre, vom ersparten Geld des teuren 4K-TVs eine HD+ Karte kaufen und die Formel 1 in nativer HD-Auflösung auf einem HD-Gerät betrachten als mit X Reality Pro 4K hochscaliertes SD auf einem 4K-Gerät. |

|||||||||||||||||||

|

Nudgiator

Inventar |

#93

erstellt: 10. Jun 2014, 21:37

|

||||||||||||||||||

|

100% Zustimmung ! Das würde uns auf alle Fälle weitere IMHO sinnlose Diskussionen ersparen  |

|||||||||||||||||||

|

George_Lucas

Inventar |

#94

erstellt: 10. Jun 2014, 21:54

|

||||||||||||||||||

Vollkommen richtig. Aber durch die Skalierung auf ein größeres Zielformat können Artefakte vermieden werden, die im Quellmaterial nicht vorhanden sind - und bei "nativer" Wiedergabeauflösung auftreten können und werden. Siehe Tiefpassfilterung. |

|||||||||||||||||||

|

hagge

Inventar |

#95

erstellt: 10. Jun 2014, 22:43

|

||||||||||||||||||

Dann erkläre mir mal, was an dieser Diskussion sinnlos ist. Wobei es mir eigentlich lieber wäre, wenn Du stattdessen ein paar fachliche Argumente bringen würdest, die für oder gegen die These sprechen, dass ein 2K-Bild in (intelligent) skalierter Version auf einem 4K-TV besser aussehen kann als nativ auf einem 2K-TV. Gruß, Hagge |

|||||||||||||||||||

|

Nudgiator

Inventar |

#96

erstellt: 10. Jun 2014, 22:57

|

||||||||||||||||||

|

@hagge Mir ging es hier vorrangig um die RC. Dazu habe ich alles gesagt: RC hat mit Skalierung nix zu tun. Das kannst Du nun glauben oder nicht. RC wurde erstmals bei 2k-Beamern eingesetzt. Der Grund war einfach: der HW50 hatte eine recht bescheidene native Schärfe. Durch die RC hat man nun versucht, die Schärfedefizite des Objektivs auszugleichen. Also nix mit Skalierung ! Natürlich hat Sony diese Technik dann auch bei TVs eingesetzt. |

|||||||||||||||||||

|

hagge

Inventar |

#97

erstellt: 10. Jun 2014, 23:10

|

||||||||||||||||||

Och komm, jetzt mach Dich nicht lächerlich. Natürlich kann man wissenschaftlich bewerten, welches von zwei Bildern näher an einem Zielbild dran ist. Nämlich indem man eine Fehlerfunktion definiert und damit den Fehlerwert für jedes der Bilder berechnet. Das Bild mit dem kleineren Fehlerwert ist näher am gewünschten Bild und sieht (bei einer sinnvollen Definition der Fehlerfunktion) darum auch besser aus.

Mal ehrlich, hast Du eigentlich auch nur einen der Beiträge wirklich durchgelesen, die ich zum Thema RC geschrieben habe? Anscheinend nicht. Denn sonst sollte Dir klar sein, wo der Mehrgewinn an Informationen herkommt. Ich kau Dir das jetzt nicht nochmal vor.

Was soll dieser völlig fehlplatzierte Sarkasmus? Es ging ursprünglich um skaliertes 2K gegen natives 2K. Und hier gibt es noch gar keine Möglichkeit, die Formel 1 in 4K zu empfangen. Meine Vergleiche mit meinem TV sind ja nur dazu da, zu zeigen dass ähnliche Verbesserungen wie bei einer 2K-auf-4K-Skalierung auch schon bisher bei der SD-auf-Full-HD-Skalierung möglich waren, es also technisch eben nicht so unmöglich ist, wie Du glauben machen willst. Dass es mit HD+ grundsätzlich eine Möglichkeit gibt, die Formel 1 in höherer Auflösung zu empfangen, ist mir natürlich klar. Es ist nur so, dass der Mehrgewinn durch dieses HD bei meinem TV meiner Meinung nach nur noch so gering ist, dass er mir keinesfalls das Geld für HD+ Wert ist. Ganz nebenbei geht es mir bei HD+ auch gar nicht ums Geld, sondern ums Prinzip. Vorrichtungen, die mich in der Möglichkeit beschneiden, das Programm so zu schauen, wie ich will, also speziell die Sendung jederzeit aufzunehmen, im Timeshift zu schauen und die Werbung zu überspulen, will ich keinesfalls unterstützen. Dass Du so ein Konzept tatsächlich gut findest, kann ich übrigens auch fast nicht glauben. Gruß, Hagge |

|||||||||||||||||||

|

-Didée-

Inventar |

#98

erstellt: 10. Jun 2014, 23:20

|

||||||||||||||||||

Ein TV-Gerät dient aber nur diesem einen Zweck: das Auge des Betrachters zu bedienen. Und wenn es für das Auge des Betrachters besser aussieht, dann ist das alles was zählt. Mathematisch-theoretische Überlegungen sind da -- in letzter Konsequenz -- scheißegal. Vgl: "psycho-visual optimisations" bei Videocodierung, wie z.B. bei x264 (AVC). Diese Optimierungen verschlechtern ganz eindeutig die mathematisch nachweisbare Qualität, aber 98 von 100 Zuschauern sind der Meinung, dass es viel besser aussieht. Genau deswegen sind psy-op's entwickelt worden. Weil die rein mathematisch-theoretische Welt sich bisweilen recht stark von dem unterscheidet, wie das HVS (human visualisation system) ein Bild wahrnimmt und interpretiert. Ach, und:

Soweit es "physikalische Messungen" angeht: die Entropie eines skalierten Bildes mit HiFreq-Anpassung ist durchaus größer als die des Ausgangsbildes. Das wird Dir jeder lossless-Codec bestätigen.  [Beitrag von -Didée- am 10. Jun 2014, 23:25 bearbeitet] |

|||||||||||||||||||

|

Nudgiator

Inventar |

#99

erstellt: 10. Jun 2014, 23:21

|

||||||||||||||||||

Ohne Worte

Hast Du schon einmal was von alternativen CAMs gehört ? Damit wirst Du nicht mehr gegängelt. Nutze ich seit zig Jahren problemlos.

Siehe oben. [Beitrag von Nudgiator am 10. Jun 2014, 23:22 bearbeitet] |

|||||||||||||||||||

|

Nui

Inventar |

#100

erstellt: 10. Jun 2014, 23:25

|

||||||||||||||||||

Hat man denn mal eine zufriedendstellende Fehlerfunktion definiert bekommen? Wobei es micht nicht wundern würde, wenn es so subjektiv bleibt, dass jegliche Fehlerfunktion hinfällig wird. Schau dir plasma vs lcd an. Da liegen doch beachtlich messbare Unterschiede und doch gibt es auf beiden Seiten schon fast fanatische Vertreter. Sollte eine solche Fehlerfunktion in diesem Falle ein Patt ergeben? [Beitrag von Nui am 10. Jun 2014, 23:28 bearbeitet] |

|||||||||||||||||||

|

hagge

Inventar |

#101

erstellt: 10. Jun 2014, 23:45

|

||||||||||||||||||

Eigentlich hast Du höchstens gesagt, wozu RC Deiner Meinung nach *nichts* zu tun hat. Wie RC aber Deiner Meinung nach funktioniert, hast Du nicht gesagt. Und warum RC nicht für eine Skalierung genutzt werden können sollte, hast Du nicht gesagt. Wieso meine Aussage falsch sein soll, dass Skalierung plus RC zusammen eine "intelligente Skalierung" ergibt, hast Du nicht gesagt. Zum Thema 2k-auf-4K-Skalierung vs. nativem 2K hast Du nichts gesagt. Und dass Sony in den eigenen Präsentationen unter dem Punkt "Upscaling" die Reality Creation mit aufzählt, ignorierst Du auch geflissentlich. Wenn man es recht bedenkt, hast Du eigentlich noch fast gar nichts gesagt, außer mir in ein paar Punkten ohne Begründung widersprochen.

Doch hat es. Das kannst *Du* nun glauben oder nicht. Selbst wenn es vielleicht (was ich übrigens noch bezweifele) in der ersten Version mal anders gedacht war, ist es in der Zwischenzeit zu *dem* Qualitätsmerkmal der Skalierung bei Sony-TVs geworden. Hättest Du den Beitrag gelesen, den ich in #74 gegen Ende verlinkt habe, dann hättest Du diese Sätze gelesen, die von den Erfindern der X-Reality PRO stammen: "Yamamoto: We refer to the database when we restore the information obtained by analyzing multiple frames. It becomes possible to create more realistic and optimal super-resolution by process of analyzing wave form from video signals and increasing resolution of various patterns within picture characteristics, instead of simply interpolating pixels. This database has thousands of patterns that are available for High Definition (HD), Standard Definition (SD), SD up-conversion, IPTV and so forth." Hier wird also auch explizit die Skalierung genannt, damals noch von SD auf HD.

Was dann genau wie funktionieren soll? Gruß, Hagge |

|||||||||||||||||||

| |||||||||||||||||||

|

|

||||

| Das könnte Dich auch interessieren: |

|

HTPC - DVD Skalierung, etc. Cahliban am 15.05.2008 – Letzte Antwort am 16.05.2008 – 3 Beiträge |

|

4k Signal auf 4 Full HD Tv? DerNeueImForum am 28.04.2017 – Letzte Antwort am 01.05.2017 – 4 Beiträge |

|

Hohe Auflösung Erzwingen (full hd) odin-TTG am 25.07.2007 – Letzte Antwort am 26.07.2007 – 3 Beiträge |

|

Auflösung und Full Speady am 27.09.2007 – Letzte Antwort am 30.09.2007 – 3 Beiträge |

|

PC SPIELE in 1.280 x 720 auf FULL HD Geräten smooth-appeal am 07.09.2009 – Letzte Antwort am 07.09.2009 – 10 Beiträge |

|

HD DVD und Full HD TV Kai45 am 25.08.2007 – Letzte Antwort am 27.08.2007 – 11 Beiträge |

|

Apple TV 4K Stream Download für Full HD TV erzwingen Merlin79 am 15.12.2017 – Letzte Antwort am 25.06.2018 – 2 Beiträge |

|

720p auf Full HD Fernseher Shaky79 am 01.07.2007 – Letzte Antwort am 04.07.2007 – 15 Beiträge |

|

Auflösung Grafkkarte-LCD TV Madej am 01.10.2008 – Letzte Antwort am 03.10.2008 – 4 Beiträge |

|

Full-HD ruckelt Jespa am 01.10.2009 – Letzte Antwort am 09.10.2009 – 15 Beiträge |

Anzeige

Produkte in diesem Thread

Aktuelle Aktion

Top 10 Threads in Scaler, Linedoubler & Videoprocessing der letzten 7 Tage

- Frage zu den Dateiformaten einer Blu-Ray Disc

- 720p auf 1080p skalieren lassen?

- PowerDVD: HD-DVD-Untertitel lassen sich nicht aus oder umschalten

- Womit Bildsignal horizontal spiegeln? (rechts <-> links)

- Videoprozessor für alte Videospiele ? ( PlayStation 1 usw )

- Ist die Kalibrierung eines TV-Gerätes sinnvoll?

- Lumagen Radiance Pro Videoprozessor 4xxx, 5xxx, 4K, DTM, Scaler, Darbee, 3D LUT

- Schwaiger Scart auf HDMI-Konverter

- Darbee 4K in 2021

- HD Fury Vertex 2

Top 10 Threads in Scaler, Linedoubler & Videoprocessing der letzten 50 Tage

- Frage zu den Dateiformaten einer Blu-Ray Disc

- 720p auf 1080p skalieren lassen?

- PowerDVD: HD-DVD-Untertitel lassen sich nicht aus oder umschalten

- Womit Bildsignal horizontal spiegeln? (rechts <-> links)

- Videoprozessor für alte Videospiele ? ( PlayStation 1 usw )

- Ist die Kalibrierung eines TV-Gerätes sinnvoll?

- Lumagen Radiance Pro Videoprozessor 4xxx, 5xxx, 4K, DTM, Scaler, Darbee, 3D LUT

- Schwaiger Scart auf HDMI-Konverter

- Darbee 4K in 2021

- HD Fury Vertex 2

Top 10 Suchanfragen

Forumsstatistik

- Registrierte Mitglieder928.750 ( Heute: 5 )

- Neuestes MitgliedMoartilie

- Gesamtzahl an Themen1.558.890

- Gesamtzahl an Beiträgen21.713.103

Die hochfrequenten hinzugeschusterten Details erdrücken doch geradezu den Rest und das Bild wirkt unecht und unausgewogen.

Die hochfrequenten hinzugeschusterten Details erdrücken doch geradezu den Rest und das Bild wirkt unecht und unausgewogen.